권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 대표형(전거형, Authority) | 생물정보 | 이형(異形, Variant) | 소속 | 직위 | 직업 | 활동분야 | 주기 | 서지 | |

|---|---|---|---|---|---|---|---|---|---|

| 연구/단체명을 입력해주세요. | |||||||||

|

|

|

|

|

|

* 주제를 선택하시면 검색 상세로 이동합니다.

Title Page

Abstract

국문요약

Contents

1. Introduction 16

1.1. Gait disorder and Assessment tools 16

1.1.1. Gait and Gait Disorder 16

1.2. Gait Assessment Tools 17

1.2.1. Functional Ambulation Category Classification (FAC) 17

1.2.2. Berg Balance Scale (BBS) 17

1.2.3. 10M Walk Test (10MWT) 18

1.2.4. 6 Minutes' Walk Test (6MWT) 19

1.2.5. Timed Up-and-Go Test (TUG test) 20

2. Background 21

2.1. Traditional Timed Up-and-Go (TUG) test 21

2.2. Introduction of the Automatic TUG test 24

2.2.1. Move Tracking Sensor Based 24

2.2.2. Ambient Sensor Based 26

2.2.3. Vision Sensor Based 28

2.3. Background Knowledge 34

2.3.1. Recurrent Neural Network (RNN) 34

2.3.2. Long Short-Term Memory (LSTM) 35

2.3.3. Bi-directional LSTM (Bi-LSTM) 36

2.3.4. Temporal Convolutional Network (TCN) 36

2.3.5. Dynamic Time Warping (DTW) 37

2.4. Motivation and Problem statement 39

2.4.1. Motivation 39

2.4.2. Problem statement 40

2.5. Summary of Contributions 41

3. Proposed Automatic TUG test Method 42

3.1. Data Acquisition Systems and Participants 42

3.2. Proposed Method 46

3.2.1. Labeling Process 48

3.2.2. Preprocessing 50

3.2.3. Deep-learning-based TUG Subtask Segmentation Algorithm 52

3.2.4. Postprocessing 54

4. Experiments and Results 56

4.1. Metrics 56

4.2. Input Comparison Study 58

4.3. Optimization of Deep Learning Model 62

4.3.1. Model Optimization 62

4.3.2. Comparison with Bi-LSTM 64

4.3.3. Performance with optimized model 66

4.4. Comparison with Rule-based Method 70

4.4.1. TUG Event Detection 70

4.4.2. TUG Subtask Segmentation 73

4.5. Comparison with ANN-based Method 75

4.6. Cross Generalization Capability 76

5. Discussion and Conclusion 79

5.1. Discussion 79

5.2. Conclusion 81

6. Future work 82

References 83

Appendices 92

Appendix A. Programs 92

Appendix B. Related Work Table 96

Figure 1.1. Example of a scoring and score interpretation of FAC. 17

Figure 1.2. Example of Berg Balance Scale score sheet. 18

Figure 1.3. Representative diagram of the 10 meter walk test. 19

Figure 1.4. Schematic diagram of the 6-minute walk test. 19

Figure 1.5. Process of the traditional TUG test. Physical therapist measures total time using stopwatch. 20

Figure 2.1. Example of the optical motion capture system. Optical motion capture suit with infrared markers (left), 3D human pose inferred from each marker (right) 25

Figure 2.2. Example of IMUs-based system. Diagram of the 17 Imus and their locations on the suit. 25

Figure 2.3. Example of the system configuration for ambient sensor-based TUG automation. 27

Figure 2.4. Walk data analysis from RGB. 28

Figure 2.5. The procedure and video recording protocol of the TUG test with RGB camera system. 29

Figure 2.6. Pose estimation example [42] for RGB camera using OpenPose 30

Figure 2.7. Azure Kinect 31

Figure 2.8. The representative illustration for rule-based method. 32

Figure 2.9. Architecture illustration of the recurrent neural network (RNN) 34

Figure 2.10. Architecture illustration of the long short-term memory (LSTM) 35

Figure 2.11. Illustration of the Bi-directional LSTM (Bi-LSTM) 36

Figure 2.12. Illustration of the temporal convolutional network (TCN) 37

Figure 3.1. System configuration for the study. The participants performed a 3 m TUG test. A cone was placed at 3 m straight from a standard chair, and Azure Kinect was installed perpendicular to the walking direction at the... 42

Figure 3.2. various environment example that this study was conducted (a) Lecture room (b) Laboratory (C) fitness room, and (4) Rehabilitation center 44

Figure 3.3. Overall flowchart of the proposed method. 47

Figure 3.4. Example of the labeling procedure 48

Figure 3.5. Self-developed labeling Tool 49

Figure 3.6. characteristics of the butter worth LPF 50

Figure 3.7. Preprocessing by low pass filter and normalization for a pelvis trajectory. 52

Figure 3.8. Architecture of dilated temporal convolutional network (TCN). 53

Figure 3.9. Sample postprocessing for correcting frame-level misclassification. 55

Figure 4.1. Skeleton joints tracked by the Azure Kinect and used inputs for comparison (red box) 59

Figure 4.2. Loss and accuracy plot for model with pelvis input 63

Figure 4.3. TUG event detection performance for each subject group 67

Figure 4.4. TUG subtask segmentation performance for each subject group 68

Figure 4.5. TUG events in Skeleton TUG and this study 71

Figure 4.6. MAE and STD in seconds between skeleton TUG (gray bar) and the proposed method (blue bar) for each TUG event. Error bars are ± the STD of the values 72

Figure 4.7. Comparison of MAE and STD for total TUG time and subtask segmentation 74

Figure 4.8. Comparison results with ANN-based method 75

최근 우리 사회는 기대수명의 증가와 출산율의 감소로 인해 전세계적인 고령화 문제를 겪고 있다. 미국 의과대학 협회의 통계에 따르면 지속적이고 빠른 고령화 속도는 물리치료사 부족 문제로 이어질 것이라고 예측하였다. 이러한 문제를 해결하고 물리치료사의 부담을 덜어주기 위해, 복잡한 재활 치료 시스템의 단순화와 보행 능력 평가도구의 자동화에 대한 연구가 이루어지고 있다.

물리치료사는 재활 치료 전과 후, 대상자의 보행 능력의 기능적 수준을 알아보기 위해 보행 능력 평가 도구를 사용한다. 현재, 임상에서는 Berg balance Scale, 10M 보행검사, 6분 걷기 검사 등 여러 도구를 사용해 대상자의 균형 능력, 보행 검사, 일상생활 수행능력 등을 평가하고 있다. 본 연구에서는 다양한 보행능력 평가 도구 중 자동화 및 분석을 위한 평가 도구로 일어서서 걷기 검사 (Timed Up-and-Go test)를 선택하였다. 물리치료사와 환자의 관점에서 검사가 비교적 간단히 이루어지기 때문에 부담이 적고, 일어서서 걷기 검사는 검사 내에 다양한 동작을 내포하고 있어 다양한 임상정보를 추출할 수 있기 때문이다.

일어서서 걷기 검사는 "Get Up-and-Go test" (GUG test)로부터 유래되었다. GUG test는 물리치료사가 대상자의 움직임을 관찰하고 이에 대해 5점 척도로 평가하는 임상방법이다. 대상자는 편안히 앉아있는 상태에서 시작한다. 곧, 물리치료사의 지시를 받아 3M를 걷고 회전 후 다시 3M를 되돌아와 의자에 앉는다. GUG test에서 객관성과 신뢰도를 높이기 위해 발전된 버전이 일어서서 걷기 검사이다. 일어서서 걷기 검사는 대상이 검사에 소요되는 총 소요시간을 측정하여 낙상의 위험도를 판별하는데 사용하며, 검사 시 보이는 움직임(짧은 보폭, 느린 보행 속도, 느린 회전 속도 등)을 통해 환자의 기능적 평가를 수행한다.

하지만, 임상에서 사용되는 현재의 일어서서 걷기 검사는 의료전문가의 지시에 따라 수행되며 이 때 걸리는 총 소요시간으로 대상자를 평가하기 때문에 수행하는 치료사에 따라 주관적인 평가가 수행되며, 보행 속도와 같은 구체적인 임상 정보를 알 수 없다는 한계가 있다. 이러한 한계를 극복하기 위해 일어서서 걷기 검사에 대한 자동화와 동작 세분화에 대한 연구가 진행되고 있다.

기존의 자동화 연구는 규칙 기반 자동화 방식(Rule-based)과 학습 기반 자동화 방식(ANN-based)으로 분류할 수 있다. 규칙 기반 자동화 방식은 획득한 데이터를 바탕으로 최대값, 최소값, 임계값 혹은 피크 찾기와 같은 규칙을 이용해 동작을 분류하는 접근법이다. 이러한 방식은 구현이 간단하다는 장점이 있지만 분류 결과 편차가 크며 대상자에 따라 최적화가 필요하다는 단점이 있다. 학습 기반 자동화 방식은 데이터의 특징을 학습하여 분류하기 때문에 규칙 기반 방식보다 분류 편차가 작지만, 학습을 위해 많은 수의 데이터가 필요하다는 단점이 있다.

본 논문에서는 관절데이터를 입력으로 한 심층학습 기반의 일어서서 걷기 검사의 자동화와 세분화하는 방법을 제안한다. 기존 일어서서 걷기 검사의 평가에 사용되던 스탑워치 대신 깊이정보 카메라를 설치하여 검사의 전 과정을 측정하였다. 제안된 방법은 깊이 정보 카메라를 통해 검사과정 동안의 대상자의 관절 정보를 취득하였으며, 관절 정보를 기반으로 대상자의 동작을 분류하고 분류 결과를 기반으로 총 소요시간뿐만 아니라 각 동작의 시간과 속도의 임상 정보를 추출하였다.

본 논문에서는 세 가지 그룹에 대해 새로이 데이터를 획득하고 제안된 방법의 성능을 이용해 성능을 검증하였다. 이 때, 제안된 방법에 대해 가장 적합한 입력을 찾기 위해 입력 선정 실험을 수행하였으며, 그 결과 pelvis 단일 입력을 사용하게 되었다. 무게중심에서 가장 가깝기 때문에 대상자의 움직임을 가장 잘 표현한 것으로 추측된다. 또한, 획득한 세 가지 그룹에 대한 성능을 평가하기 위해 제안된 방법의 심층학습 모델을 최적화하였으며, 그 결과 정상인 청년 = 95.458%, 고령자 =94.525%, 뇌졸중 환자=93.578% 의 동작 분류 정확도를 검증하였다.

본 논문에서는 제안된 방법의 성능을 검증하기 위해 기존의 카메라 기반 일어서서 걷기 검사 자동화 연구와의 비교를 수행하였다. 기존에 깊이 카메라를 이용해 일어서서 걷기 검사를 자동화한 심층학습 기반의 연구가 없었기 때문에 기존 연구와의 성능 비교는 두가지 실험을 통해 증명되었다. 또한, 추가적으로 타 연구에서 많이 사용되는 심층 학습 네트워크인 Bi-LSTM 과의 비교를 통해 가급적 본 연구의 성능을 검증하고자 하였다. 그 결과, 제안된 방법이 기존 연구와의 Rule-based, ANN-based 보다 높은 정확도와 강건함을 보이는 것을 확인할 수 있었다. 또한, Bi-LSTM과의 비교를 통해 제안된 방법이 정확도는 약 0.3%더 높은 정도로 큰 차이를 보이지 않지만, 학습에 필요한 파라미터 수가 약 13배 더 적게 필요한 것을 확인하였다. 이는 향후, 임베딩을 통한 '자택 내 자가 진단 시스템"에 제안된 방법이 더 적합한 것으로 해석할 수 있다.

한편, 기존의 일어서서 걷기 검사 자동화 연구는 모두 특정한 대상군을 위한 연구를 수행하였다. 예를 들면, 파킨슨 병 환자를 대상으로 한 일어서서 걷기 검사 자동화, 고령자를 대상으로 한 검사 자동화, 뇌졸중 환자를 대상으로 한 검사 자동화와 같이 특정 대상군에 대해서만 데이터를 획득하고 동작 가능한 자동화 연구를 수행하였다. 하지만, 일어서서 걷기 검사는 임상에서 알츠하이머, 골 관절염, 뇌졸중, 파킨슨 병, 노인증후군 등 다양한 환자를 대상으로 수행된다. 이러한 다양한 환자군에 대해 자동화 및 세분화 연구를 위해 매번 데이터를 획득하고 심층 네트워크를 학습시키는 것은 엄청난 인적·물적 낭비를 초래한다. 즉, 실제 임상이나 일상생활에서 연구결과가 사용되기 위해서는 연구가 보다 다양한 대상군에 대해 적용될 수 있도록 일반화될 필요가 있다.

본 논문에서는 일어서서 걷기 검사 자동화 및 세분화 연구가 별도의 데이터 수집 없이 다양한 환자군에 대해 적용될 수 있는지에 대한 가능성을 검토하였다. 무게중심에서 가장 가까운 pelvis 관절을 입력으로 하여 뇌졸중 환자, 고령자, 정상인에 대한 일반화 성능을 평가하였으며, 그 결과, 모든 그룹이 pelvis 입력에 대해 비교적 높은 일반화 성능을 보였다. 그 중, 고령자로 학습 후 청년을 테스트하였을 때 가장 일반화 성능이 좋았으며 정상인 청년을 대상으로 학습 후 뇌졸중 환자를 검사하였을 때 가장 나쁜 성능을 보였다. 이러한 결과는 환자의 유형에 관계없이 골반 입력만으로 일어서서 걷기 검사를 자동화하고 세분화할 수 있다는 가능성을 보여준다.*표시는 필수 입력사항입니다.

| *전화번호 | ※ '-' 없이 휴대폰번호를 입력하세요 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

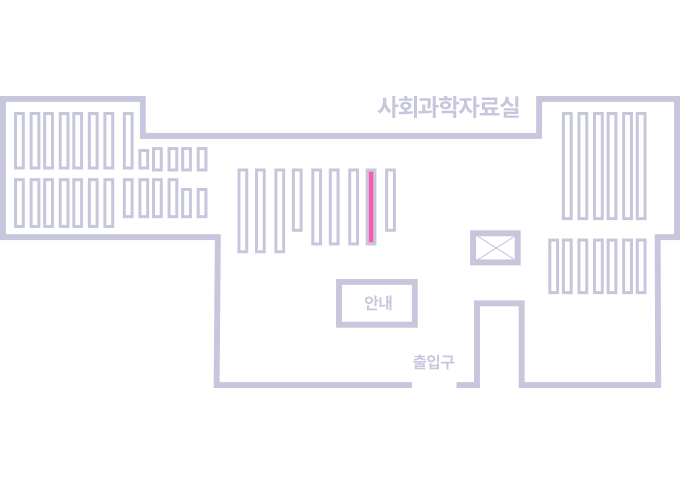

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.