권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

Title Page

ABSTRACT

Contents

Chapter 1. Introduction 10

1.1. Motivation 10

1.2. Research Scope 11

1.3. Organization 12

Chapter 2. Backgrounds 13

2.1. Dynamic Motion Primitives 13

2.2. Generalization of DMPs for LfD 14

2.3. Optimization-based Motion Planning 16

2.4. Particle Swam Optimization 18

Chapter 3. Trajectory Optimization with Particle Swarm Optimization for Learning from Demonstration 21

3.1. Trajectory Modification for LfD 21

3.2. PSO for Trajectory Optimization 22

3.3. Cost Function Design 22

3.4. Boosted PSO for Trajectory Optimization 25

3.5. Reuse Method for Optimized Parameters 26

Chapter 4. Simulation Studies 33

4.1. Simulation Setup 33

4.2. Comparison of Trajectory Optimization Methods 36

4.2.1. Trajectory Optimization in 150 Dimensional Space 37

4.2.2. Trajectory Optimization in 30 and 300 Dimensional Space 45

4.2.3. Trajectory Optimization with Population Size 10 46

4.2.4. Trajectory Optimization in Various Environments 51

4.2.5. Computation Time 53

4.3. Result for Reuse of Optimized Parameters 55

Chapter 5. Experiments 58

5.1. Experiment on three-axis Robot Manipulator 58

5.1.1. Robot and Environment Setting 58

5.1.2. Trajectory Optimization Result for Manipulator 58

5.2. Experiment on six-axis Robot Manipulator 59

5.2.1. Robot and Environment Setting 59

5.2.2. Trajectory Optimization Result for Manipulator 60

Chapter 6. Conclusion and Future Works 67

References 68

Summary 73

2.1. Example plot of DMP when βz=1.0, αz=4βz, g=1.0, and τ=1.0. The y and z converge...(이미지참조) 14

2.2. Example plot of DMP with a function f=3sin(2πt) when βz=1.0, αz=4βz, αx=0.01,...(이미지참조) 15

2.3. Procedure for RTW(Raw Trajectories Generalization) 16

2.4. Procedure for MPG(Movement Primitives Generalization) 17

3.1. Procedure for adapting trajectory for constraints 22

3.2. Encoding example of a particle when dimension for a workspace is one. Trajectory modifi-... 23

3.3. D=WD×TN dimensional modification vector. The modification vector in each workspace... 23

3.4. Initialization of the particles with a normal distribution with standard deviation α=1.0 and... 27

3.5. Procedure for improving adaptability of LfD with PSO. When a trajectory from LfD module... 28

3.6. The trajectory modification storage vector (TMS). When a trajectory that violates the... 29

3.7. Framework for using previous optimized-parameter. When a trajectory from LfD module is... 31

4.1. Kinematic model of arm. The robot has 3 joints and 4 links. First joint rotates along y axis... 34

4.2. Trajectories for learning MPG. Each trajectory starts from an initial position and reaches a... 34

4.3. Trajectories of each joint in joint space for learning MPG. Each angles starts from 0 rad and... 35

4.4. Trajectories of each joint in Cartesian space for learning MPG. Each trajectory start from a... 35

4.5. Settings for initial trajectory and obstacles. The trajectory optimization method modifies... 36

4.6. Trajectory after optimization with STOMP. The final trajectory is a combination of the... 38

4.7. Trajectory after optimization with BBDE. The final trajectory is a combination of the initial... 39

4.8. Trajectory after optimization with GS. The final trajectory is a combination of the initial... 39

4.9. Trajectory after optimization with GSN. The final trajectory is a combination of the initial... 40

4.10. Trajectory after optimization with SQP. The final trajectory is a combination of the initial... 40

4.11. Trajectory after optimization with BPSO. The final trajectory is a combination of the initial... 41

4.12. Trajectory adaptation result with STOMP in three dimensional space 41

4.13. Trajectory adaptation result with BBDE in three dimensional space 42

4.14. Trajectory adaptation result with GS in three dimensional space 42

4.15. Trajectory adaptation result with GSN in three dimensional space 43

4.16. Trajectory adaptation result with SQP in three dimensional space 43

4.17. Trajectory adaptation result with BPSO in three dimensional space 44

4.18. Cost for each iteration when total number of steps was 50 44

4.19. Cost for each iteration when total number of steps was 10 45

4.20. Cost for each iteration when total number of steps was 100 46

4.21. Cost for each iteration when total number of steps was 10 and population size was 10 48

4.22. Cost for each iteration when total number of steps was 50 and population size was 10 48

4.23. Cost for each iteration when total number of steps was 100 and population size was 10 49

4.24. List of normalized step cost (NSC) vector on various environments 55

4.25. Confusion matrix calcuated with similarity measure in (3.16) 56

4.26. Costs in BPSO and BPSO-TMS for each iteration 56

5.1. Three-axis manipulator for the experiment. The robot has the same configuration as in the... 59

5.2. Cost for each iteration with three-axis manipulator 60

5.3. Trajectory after optimization with STOMP for three-axis manipulator 61

5.4. Trajectory after optimization with SQP for three-axis manipulator 61

5.5. Trajectory after optimization with BPSO for three-axis manipulator 62

5.6. Trajectory after optimization in 3D with STOMP for three-axis manipulator 62

5.7. Trajectory after optimization in 3D with SQP for three-axis manipulator 63

5.8. Trajectory after optimization in 3D with BPSO for three-axis manipulator 63

5.9. The experimental result with BPSO for three-axis manipulator. The BPSO modified the... 64

5.10. Six-axis manipulator for the experiment. The robot has 6 joints and 3 links. First joint... 64

5.11. Cost for each iteration with six-axis manipulator 65

5.12. Trajectory for six-axis manipulator in Cartesian coordinate 65

5.13. Target angles for six-axis manipulator 66

5.14. Trajectory after optimization in 3D for six-axis manipulator 66

고차원에서 운동계획을 하기 위한 한가지 접근 방법은 시범에 의한 학습 (Learning from Demonstration, LfD) 이다. 이 방법에서는 로봇이 따라야 할 궤적을 사람의 시범을 통해서 추출하고 추출된 궤적을 학습하여 추후에 비슷한 운동계획 시에 이 궤적을 이용한다. 이 LfD이 가지는 장점은 특정 작업에 특화된 궤적들을 빠른 시간 안에 생성할수 있는 것이다. 운동계획시 이 방법의 경우 학습에 이용된 궤적과 비슷한 궤적만을 생성해낼 수 있고 학습에 사용되지 않은 추가적인 제한조건을 만족하는 운동계획을 새로 해야 할 경우에는 그에 적합한 궤적을 생성하지 못하는 제한 점이 존재한다.

본 논문에서는 이와 같은 제한 점을 해결하고 LfD의 적응성을 향상시키기 위해 입자군집최적화(Particle Swarm Optimization, PSO)를 통해 LfD로 생성된 궤적을 변경하는 방법을 제시한다. 이 PSO는 집단의 정보를 이용하는 확률적 전역 최적화 방법으로 간단한 구조와 빠른 수렴속도를 보이고 이 특징은 운동계획에 적용하기에 적합하다. 이 PSO를 이용하기 위해 본 논문에서는 궤적 변경 정도의 변수화 및 제한조건들을 다루는 비용 함수 설계에 대한 내용을 포함한다. 궤적 각각의 단계에서 변경되는 정도는 입자에 설정되고 초기 궤적에 변경된 정도를 더해진 후 비용함수에서 평가된다. 이 최적화는 동일조건을 만족하면서 비용을 최소화하는 제한 최적화 문제로 다룬다. 장애물 회피에 대한 제한 조건을 동일 조건으로 설정하고 이 조건을 만족하지 않을 때는 큰 패널티 값을 할당하여 적합하지 않은 영역에서 벗어나도록 한다. 최단거리, 최소가속, 최소변경에 대한 제한조건의 비용은 0과 1로 정규화하여 제한조건들 간의 크기 특성을 제거하였다. PSO에서 입자들의 일반적인 초기화 방법은 탐색공간에서 균일 무작위 함수를 사용하는 것이다. 하지만 이 방법은 탐색 범위가 넓은 궤적 최적화 문제에서는 나쁜 결과를 낸다. 본 논문에서는 정규화된 비용(Normalized Step Cost, NSC)을 입자 초기화에 이용하는 boosted PSO (BPSO)를 제안한다. 제안한 방법은 궤적 최적화에 PSO를 적용할 때 수렴속도를 가속시킨다. 기존에 최적화된 파라미터를 재사용하는 방법 또한 제안된다. 최적화된 파라미터들은 NSC 특징 벡터와 함께 저장되고 질의 NSC가 입력으로 주어졌을 때 저장된 NSC 중 가장 유사한 NSC를 찾고 이와 함께 저장되었던 파라미터가 선택된다. 선택된 파라미터는 입자들을 초기화 하는데 이용된다. 이 접근 방법은 기존에 최적화된 파라미터를 다시 최적화 하는 필요를 줄이고 운동계획의 시간을 줄인다.

제안된 방법은 로봇 팔의 목적지 도달 작업에 적용하여 검증하였다. 이 작업은 일상생활에서 이루어지는 동작 계획에 있어서 핵심적인 작업이며 물건을 집고 놓는 작업과 같은 다양한 작업에 확장될 수 있다. LfD에서 생성된 궤적을 변경하는 시뮬레이션에서 여러 최적화 방법과 제안된 방법을 비교 하였으며 수렴 속도, 계산 속도, 최종 비용 값에 있어 제안한 방법이 가장 좋은 성능을 내었다. 제안된 방법은 또한 실제 로봇 팔에 적용되었고 제한조건들을 만족하는 궤적을 생성하는 것을 확인 하였다.*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

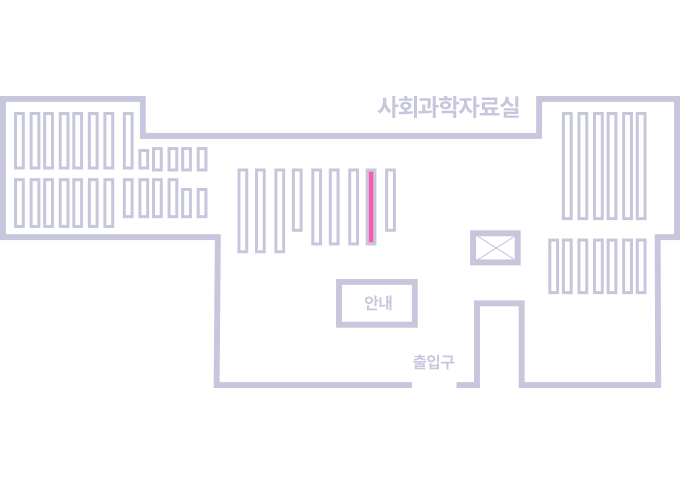

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.