권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

표제지

목차

국문초록 7

1. 서론 9

2. 연구 배경 12

가. 기존 GPU 구조 12

나. GPU 메모리 계층 15

다. 워프 스케줄링 기법에 따른 병렬성 17

라. 워프 스케줄링 연구 19

마. 캐쉬 관리 기법 24

3. MSHR 활용률 기반 동적 워프 스케줄링 기법 27

가. 메모리 경합 측정 27

나. MSHR 사용 기반 동적 워프 스케줄러 구현 28

4. 지연시간 숨김 기반 워프 스케줄링 기법 33

가. 지연시간 숨김 33

나. 워프 내 데이터 지역성 활용 36

5. 캐쉬 유용성 평가 기반의 우회 접근 기법 40

가. GPU 캐쉬 효율 40

나. 캐쉬 우회 기법의 개요 42

다. 캐쉬의 효율성 분석 44

라. 2단계 우회 결정 기법 46

마. 하드웨어 구현 47

6. 모의실험 환경 및 결과 50

가. MSHR 활용률 기반 동적 워프 스케줄링 기법의 실험 방법 50

나. MSHR 활용률 기반 동적 워프 스케줄링 기법의 실험 결과 분석 52

다. 지연시간 숨김 기반 워프 스케줄링 기법의 실험 방법 57

라. 지연시간 숨김 기반 워프 스케줄링 기법의 실험 결과 분석 59

마. 캐쉬 유용성 평가 기반의 우회 접근 기법의 실험 방법 64

바. 캐쉬 유용성 평가 기반의 우회 접근 기법의 실험 결과 분석 66

7. 결론 73

참고문헌 75

Abstract 80

그림 1. Streaming Multiprocessor 구조 14

그림 2. GTO 정책과 LRR 정책의 워프 수준 병렬성 비교 19

그림 3. 제안하는 워프 스케줄링 기법을 위한 블록 다이어그램 32

그림 4. 워프스케줄링 정책 비교 35

그림 5. 제안된 워프 스케줄러 구조 37

그림 6. 캐쉬 사용 여부에 따른 성능 여부 41

그림 7. 응용 프로그램별 L1 데이터 캐쉬 미스율 42

그림 8. 제안한 캐쉬 우회 기법의 순서도 43

그림 9. 제안된 3가지 유형의 미스율 범위 45

그림 10. 제안된 기법을 지원하기 위한 수정된 SM 48

그림 11. MSHR 엔트리 사용량 T에 따른 제안된 기법의 IPC 변화 53

그림 12. L1 데이터 캐쉬 미스율 비교 54

그림 13. 3MM 애플리케이션의 MSHR 사용률 55

그림 14. 내부 연결망 스톨 사이클 56

그림 15. L2 캐쉬 미스율 57

그림 16. L1 데이터 캐쉬 미스율 60

그림 17. L1 데이터 캐쉬에서의 점유 실패 사이클 비교 61

그림 18. 파이프라인 스톨 사이클 62

그림 19. 워프스케줄링 정책에 따른 IPC 64

그림 20. 미스율 기반의 우회의 성능 67

그림 21. 제안하는 우회 기법의 성능 비교 69

그림 22. 제안하는 기법에 따른 L1 데이터 캐쉬에서의 우회 비율 70

그림 23. 제안 기법에 따른 미스율 71

그림 24. 임계값 w에 따른 성능 변화 72

GPU는 병렬처리가 가능한 강력한 하드웨어 자원을 기반으로 높은 처리량을 제공한다. 하지만 과도한 메모리 요청이 발생하는 경우 캐쉬 효율이 낮아져 GPU 성능이 크게 감소할 수 있다. 캐쉬에서의 경합이 심각하게 발생한 경우 동시 처리되는 스레드의 수를 감소시킨다면 캐쉬에서의 경합이 완화되어 전체 성능을 향상시킬 수 있다. 본 연구에서는 캐쉬에서의 경합 정도에 따라 동적으로 병렬성을 조절할 수 있는 워프 스케줄링 기법을 제안한다. 기존 워프 스케줄링 정책 중 LRR은 GTO에 비해 워프 수준의 병렬성이 높다. 따라서 제안하는 워프 스케줄러는 L1 데이터 캐쉬 경합 정도를 반영하는 MSHR(Miss Status Holding Register) 이 낮은 자원 활용률을 보일 때 LRR 정책을 적용한다. 반대로 MSHR 자원 활용률이 높을 때는 워프 수준의 병렬성을 낮추기 위해 GTO 정책을 적용하여 워프 우선순위를 결정한다. LRR(Loose Round Robin) 워프 스케줄링 정책을 적용한 GPU 구조는 높은 병렬성과 워프 사이의 균등한 작업처리를 보인다. 하지만 기존 LRR 정책은 다수의 워프들이 균등하게 이슈됨에 따라 다수의 워프가 동시에 긴 지연시간을 발생시키는 경향을 보인다. 긴 지연시간동안 동시 수행할 워프가 준비되지 않는다면 GPU의 처리량은 크게 감소한다. 본 연구에서는 긴 지연시간을 발생시키는 명령어 이후에 다른 명령어를 동시 수행함으로써 지연시간을 효과적으로 숨길 수 있는 워프 스케줄링 기법을 제안한다. 제안하는 기법은 동적으로 스케줄링 정책을 선택하기 때문에 기존의 고정된 LRR과 GTO에 비해 높은 IPC 성능과 캐쉬 효율을 보여준다. 실험 결과 MSHR 사용 기반의 동적 워프 스케줄링 기법은 LRR 정책에 비해 약 12.8%, GTO 정책에 비해 약 3.5% IPC 향상을 보인다. 또한, 지연시간 숨김 활용 기반의 워프 스케줄링 기법은 LRR 정책에 비해 약 12.7%, GTO 정책에 비해 약 5.6% 성능 향상을 보인다.

최신 GPU 구조는 L1 데이터 캐쉬의 병목 문제를 상당히 완화시키는 정책과 구조를 채택함으로써 처리량을 상당히 향상시킨다. 하지만, 캐쉬 미스율은 대부분의 응용 프로그램에 대해 여전히 50% 이상의 높은 수치를 보이고 있다. 캐쉬 미스율은 캐쉬 효율에 대한 합리적인 척도이지만 GPU 성능에 반드시 비례하진 않는다. 또한, 본 연구의 실험 결과에 따르면 온-칩 캐쉬가 반드시 GPU 성능 향상에 도움이 되지 않는다. 본 연구에서는 L1 데이터 캐쉬의 사용 여부에 따라 성능 이득을 예측하기 위해 미스율만을 사용하는 것은 부정확하다는 문제점을 극복하기 위한 두 번째 성능 이득 결정 요소를 제안한다. 최신 GPU 캐쉬를 사용하면 병목 현상이 완화되기 때문에 이전 아키텍처에 비해 높은 병렬성으로 얻는 이득이 증가한다. 따라서 제안된 우회 기법은 캐쉬 효율성과 처리량 간의 균형을 측정하여 캐쉬 사용 여부를 동적으로 결정한다. 캐쉬의 처리량은 워프 풀에서의 워프 점유 정보를 기반으로 예측할 수 있다. 작업 부하가 상당히 높거나 낮은 미스율을 보이지 않아 단순히 미스율을 기반으로 캐쉬 이득을 예측할 수 없는 경우 워프 점유율을 기반으로 최종 우회를 결정한다. 만약 워프 이슈 단계에서 충분한 워프를 사용할 수 없는 경우, 캐쉬에서도 낮은 병렬성이 예측되므로 L1 데이터 캐쉬는 오랜 사이클동안 동작하지 않도록 한다. 제안된 2레벨 우회 기법은 최신 GPU 구조에 대해 기존 병목현상 기반 또는 미스율 기반의 우회보다 높은 성능을 보이며, 최신 GPU 구조에 비해 평균 7.2% 성능 향상을 보인다.*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

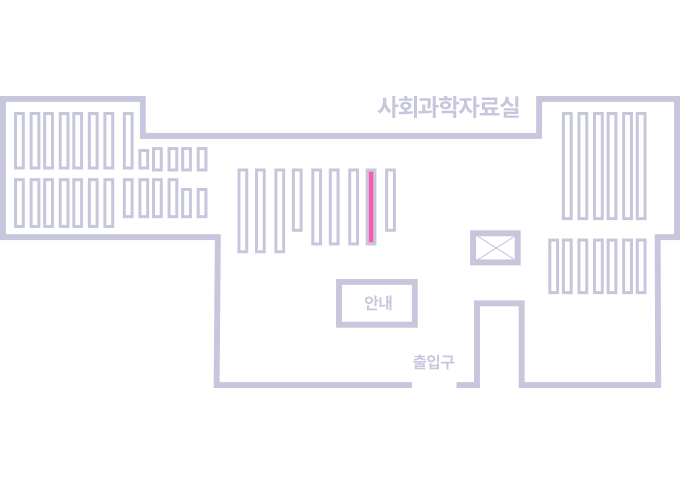

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.