권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

표제지

요약

목차

기호설명 10

I. 서론 12

1. 연구 배경 및 관련 연구 12

2. 연구 목표 13

II. 시스템 구성 15

1. 하드웨어 시스템 구성 15

1) 기구 시스템 구성 15

2) 하드웨어 인터페이스 구성 16

2. 소프트웨어 시스템 구성 18

1) 시스템 통합 프레임워크 구성 18

2) 소프트웨어 인터페이스 구성 19

3) 통합 GUI 환경 구성 20

3. 메카넘 휠 플랫폼 시스템 모델링 21

III. 동시적 위치 추정 및 지도 작성 (SLAM) 25

1. 추측 항법 (Dead Reckoning) 25

2. 트래킹 카메라를 이용한 위치 추정 방법 27

3. 위치 오차 추가 보정 방법 29

1) 적응 상보 필터 (Adaptive Complementary Filter) 29

2) Adaptive Monte Carlo Localization (AMCL) 31

4. 실시간 2D 지도 작성 32

1) 개요 32

2) 2D Lidar 병합 작업 32

3) 2D 지도 작성 패키지 (Cartographer) 33

5. 적용 결과 35

1) 위치 추정 알고리즘 35

2) 2D 지도 작성 38

IV. 로봇 플랫폼 제어 알고리즘 39

1. 목표 속도 추종 제어 방법 39

1) 플랫폼 시스템 모델 기반 제어 39

2) 플랫폼 주행기록계 기반 피드백 제어 40

3) 알고리즘 결합 40

2. 로봇 팔 제어 방법 및 활용 방안 42

1) 로봇 팔 제어 방법 42

2) 활용 방안 43

3. 적용 결과 44

1) 목표 속도 추종 제어 44

2) 로봇 팔 제어 46

V. 자율 주행 알고리즘 48

1. 자율 주행 알고리즘 48

1) BT Navigator Server 49

2) Planner Server 50

3) Controller Server 50

4) Recovery Server 51

5) Costmap Client 51

6) AMCL 51

7) Map Server 51

2. 3D 객체 인식 알고리즘 및 활용 방안 52

1) 개요 52

2) 알고리즘 설명 53

3) 알고리즘 구현 54

4) Point Cloud Publisher 54

5) Object Detector 56

4) 활용 방안 58

3. 패턴 주행 경로 생성 알고리즘 59

4. 적용 결과 60

1) 자율 주행 알고리즘 60

2) 3D 객체 인식 61

3) 패턴 주행 경로 생성 62

VI. 실험 결과 및 분석 63

1. 개요 63

2. 웨이포인트 자율 주행 시나리오 설명 63

3. 패턴 자율 주행 시나리오 설명 65

4. 동적 장애물 인식 및 대응 시나리오 설명 67

5. 로봇 팔 제어 시나리오 설명 69

6. 시나리오별 동작 수행 결과 71

1) 웨이포인트 자율 주행 71

2) 패턴 자율 주행 72

3) 동적 장애물 인식 및 대응 73

4) 로봇 팔 제어 75

VII. 결론 76

참고문헌 78

Abstract 81

Fig. 2.1. Hardware Interface Block Diagram of Robot Platform 16

Fig. 2.2. Software Interface Block Diagram 19

Fig. 2.3. Graphical User Interface of Robot Platform 20

Fig. 2.4. Analytical Model of Single Mecanum Wheel 21

Fig. 2.5. Analytical Model of Mecanum Wheel Platform 22

Fig. 3.1. Split Velocity Vector into Reference Coordinate Units 25

Fig. 3.2. Dead Reckoning Process of Robot Platform 26

Fig. 3.3. Intel Realsense T265 Camera (Left) and Fish eye Cameras (Right) 27

Fig. 3.4. Odometry Estimation using T265 Camera 28

Fig. 3.5. 2D Lidar Sensors Attached to the Robot Platform 32

Fig. 3.6. Merging Algorithm of Multiple 2D Lidar Scan Data 33

Fig. 3.7. 2D Mapping Process Using Cartographer Package 34

Fig. 3.8. Straight Lane Driving for Localization Result 35

Fig. 3.9. Rotational Driving for Localization Result 35

Fig. 3.10. Result of Straight Lane Driving 36

Fig. 3.11. Result of Rotational Driving 37

Fig. 3.12. Result of 2D Mapping using 2D Lidar Sensor 38

Fig. 4.1. Block Diagram of System Model based Control 39

Fig. 4.2. Block Diagram of Platform Velocity Feedback based Control 40

Fig. 4.3. Block Diagram of Merged Control System 41

Fig. 4.4. The Robot Arm Attached to Robot Platform 42

Fig. 4.5. The Result of x, y Axis Velocity Error in Model Based Control 45

Fig. 4.6. The Result of Yaw Angular Velocity Error in Model Based Control 45

Fig. 4.7. The Result of x, y Axis Velocity Error in Merged Control 45

Fig. 4.8. The Result of Yaw Angular Velocity Error in Merged Control 45

Fig. 4.9. Description of Experiment for Robot Arm 46

Fig. 4.10. Result of Experiment for Robot Arm 47

Fig. 5.1. Block Diagram of Navigation 2 Package on Robot Platform 48

Fig. 5.2. Block Diagram of Platform Behavior Tree Structure 49

Fig. 5.3. Limitation of 2D Lidar Sensor in Autonomous Driving 52

Fig. 5.4. Image Process Block Diagram of 3D Object Detection Algorithm 53

Fig. 5.5. Output from Depth Camera (Left: RGB Image, Right: Depth Image) 54

Fig. 5.6. Inverse Projection of Depth Camera 55

Fig. 5.7. Result of Inverse Projection Algorithm (3D Point Cloud) 55

Fig. 5.8. Output Data Structure in Point Cloud Publisher Node 56

Fig. 5.9. Result of RGB Object Detection 57

Fig. 5.10. Result of Clustering Point Cloud Data in Bounding Box 57

Fig. 5.11. Result of Executing Object Detector Node 58

Fig. 5.12. Process of Creating Pattern Driving Path in Selected Area 59

Fig. 5.13. Process of Autonomous Driving on Robot Platform 60

Fig. 5.14. Description of 3D Object Detection Experiment 61

Fig. 5.15. Description of Creating Pattern Driving Path in GUI 62

Fig. 5.16. Result of Creating Pattern Driving Path in GUI 62

Fig. 6.1. System Block Diagram of Waypoint Autonomous Driving Scenario 64

Fig. 6.2. Flowchart of Waypoint Autonomous Driving Scenario 64

Fig. 6.3. System Block Diagram of Pattern Autonomous Driving Scenario 65

Fig. 6.4. Flowchart of Pattern Autonomous Driving Scenario 66

Fig. 6.5. System Block Diagram of Obstacle Avoidance Driving Scenario 67

Fig. 6.6. Flowchart of Obstacle Avoidance Driving Scenario 68

Fig. 6.7. System Block Diagram of Robot Arm Control Scenario 69

Fig. 6.8. Flowchart of Robot Arm Control Scenario 70

Fig. 6.9. Description of Waypoint Autonomous Driving 71

Fig. 6.10. Result of Waypoint Autonomous Driving 71

Fig. 6.11. Description of Pattern Autonomous Driving 72

Fig. 6.12. Result of Pattern Autonomous Driving 73

Fig. 6.13. Example of Dynamic Obstacle Detection 74

Fig. 6.14. Result of Dynamic Obstacle Detection 74

Fig. 6.15. Result of Operating Elevator Button using Robot Arm 75

본 연구는 자율 주행 로봇에 필요한 위치 추정, 자율 주행 등 핵심 기능을 지닌 로봇 플랫폼 시스템을 제안한다. 이를 위해 동시적 위치 추정 및 지도 작성 기능의 구현, 플랫폼 제어 알고리즘의 구현, 자율 주행 기능의 구현, 시나리오 설정 및 구현의 4가지 연구 목표를 설정하고 이에 맞춰 개발을 진행하였다.

먼저 본 연구에서 채택한 메카넘 휠 플랫폼의 동적 시스템 모델에 대해 해석을 진행한 후, 이를 바탕으로 IMU 센서와 엔코더 센서를 결합하여 추측 항법을 진행하였다. 한편, 추측 항법에서 생길 수 있는 외란의 영향을 줄이기 위해 T265 트래킹 카메라를 추가 활용한 적응 상보 필터와 AMCL 알고리즘을 사용하여 보정하였다.

한편, 플랫폼 자율 주행 기능 구현을 위해 모델 기반 제어 방식과 피드백 기반 제어 방식을 결합한 속도 추종 제어를 구현하였으며, 복잡한 작업 수행을 위해 로봇 팔 제어 기능을 구현하였다. 그 후 오픈 소스 라이브러리인 Navigation 2를 활용하여 2D Lidar 기반 실내 자율 주행 기술을 구현하였다.

또한, Lidar 기반 환경 인지가 갖는 한계를 극복하기 위해 깊이 카메라를 사용하여 역 투사 기법과 CNN 기반 Detector를 결합한 3D 객체 인식 기술을 구현하였다. 객체 인식 기술은 실험 결과 약 7.6cm의 평균 위치 오차를 보이는 것을 확인하였다.

마지막으로 웨이포인트 주행, 패턴 주행, 장애물 인식, 로봇 팔 제어의 네 가지 시나리오를 설정하고 해당 작업을 수행하기 위해 구현한 기술들을 유기적으로 연결하였다. 실험 결과 일부 예외 상황을 제외하면 오동작 없이 정상적으로 시나리오에 맞게 작업을 수행하는 것을 확인하였다.

본 연구를 통해 기술적인 어려움에 부딪혀 실내 자율 주행 로봇을 개발하지 못하고 있는 많은 기업들에게 도움을 줄 수 있을 것으로 기대한다.*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

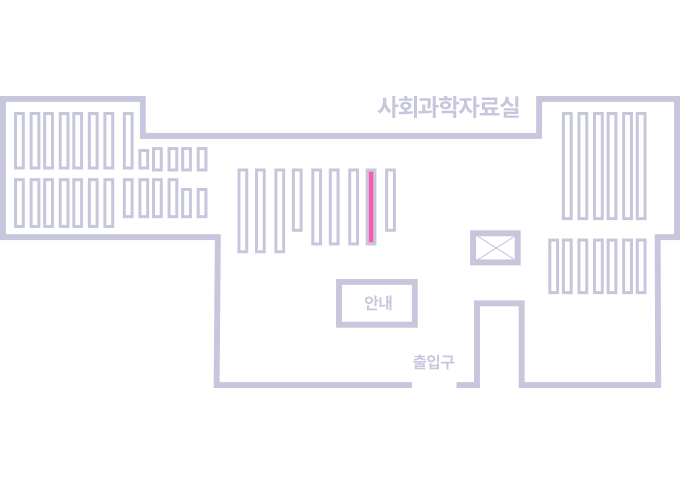

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.