권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

Title Page 1

Abstract 4

Contents 7

Ⅰ. Introduction 13

Ⅱ. STHarDNet: Swin Transformer with HarDNet for Medical Images Segmentation 16

1. Background 16

2. Related Works 20

2.1. CNN based Segmentation Models 20

2.2. Transformer with CNN in Segmentation Models 22

2.3. HarDNet Block 22

2.4. Swin Transformer Block 23

2.5. Past Studies on Models Constructed Based on ATLAS Dataset 27

3. Datasets 29

3.1. CT Dataset: Intracerbral Hemorrhage(ICH) 29

3.2. MRI Dataset: ATLAS 31

4. The Proposed Method: STHarDNet 33

4.1. HarDNet (HarDNet based UNet) 34

4.2. Swin Transformer 37

5. Experimentation 40

5.1. Performance Evaluation Method 40

5.2. Experimental Environment and Parameter Settings 41

5.3. Performance Comparison Experiments on CT Images 42

5.4. Performance Comparison Experiments on MRI scans 44

5.5. Speed Comparison Experiments of Models 47

6. Conclusions of Chapter 49

Ⅲ. FOAAI: Fashion Occlusion Area Automatic Inpainting for A Fashion Product Area Extraction 51

1. Background 51

2. Related Works 62

2.1. Fashion Product Area Extraction Technology 62

2.2. Applications of Image Inpainting Technology in Fashion Field 64

2.3. Applications based on Fashion Product Area Extraction 66

2.4. Survey of Fashion Datasets 68

2.5. Research Gap 78

3. Datasets 80

3.1. DeepFahion2 Dataset 80

3.2. LIP Dataset 81

4. The Proposed Method: Fashion Occlusion Area Automatic Inpainting(FOAAI) 82

4.1. Segmentation Module 84

4.2. Human Parsing Module 84

4.3. Occlusion Area Extraction Module 87

4.4. Occlusion Area Inpainting Module 92

5. Experimental Setup and Results 95

5.1. Experimental Design 95

5.2. Experimental Results 102

6. Conclusion of Chapter 107

Ⅳ. Conclusions 109

1. Improvement the Segmentation Performance and Speed 109

2. Reduction of the Effect of the Occlusion Area on Object Extraction 110

3. Future Research 112

References 113

국문초록 131

[Figure 1] Example of patch merging in windows of Swin Transformer 24

[Figure 2] Example of shifted window approach of Swin Transformer 25

[Figure 3] Example of connection of Swin Transformer blocks 26

[Figure 4] Examples of CT scans dataset 30

[Figure 5] Examples of ATLAS dataset 32

[Figure 6] Architecture of STHarDNet 34

[Figure 7] Architecture of HarDNet 35

[Figure 8] Architecture of Swin Transformer 39

[Figure 9] Analysis of automated fashion service processes 52

[Figure 10] Example of fashion product area extraction from image 54

[Figure 11] Types of segmentation data 56

[Figure 12] Segmentation-based fashion product extraction method 58

[Figure 13] Proposed fashion product area extraction method based on image inpainting 60

[Figure 14] Example of occlusion area in the Deepfashion2 dataset 63

[Figure 15] Application examples in the fashion field of image inpainting technology 65

[Figure 16] Display the fashion datasets on the timeline 69

[Figure 17] Examples os UT Zapos50K dataset 71

[Figure 18] Examples of DARN dataset: the paris of online and offline images 72

[Figure 19] Examples of attribute prediction in Deepfashion dataset 74

[Figure 20] Examples of Fashion-MNIST 76

[Figure 21] Fashion product area extraction module based on image inpainting 83

[Figure 22] Example of human parsing result 85

[Figure 23] Examples of images output in each step 90

[Figure 24] Fashion product extraction method based on segmentation 91

[Figure 25] Example inputs and outputs of the image inpainting module 93

[Figure 26] Similar fashion product image search system 96

[Figure 27] Dataset types 100

[Figure 28] Product area samples extracted by three fashion product extraction methods 101

[Figure 29] Similar fashion product image search result graph for the total dataset 104

[Figure 30] Similar fashion product image search result graph for occlusion dataset 106

본 연구에서는 의료 영상 및 패션 도메인에서 segmentation을 위한 딥러닝 네트워크를 제안한다. 의료 영상 뇌 CT, MRI 영상에서의 질환 segmentation 모델의 성능을 높이기 위해 본 연구에서는 CNN과 vision transformer의 결합 네트워크 구조를 제안한다. 그리고 패션 도메인에서는 사전 학습된 멀티 모델의 출력층을 연결해 패션 상품을 가린 occlusion 영역을 자동으로 복구함으로써 더 정확한 패션 상품의 영역을 추출하는 방법을 제안한다.

(의료 영상)본 연구에서는 HarDNet과 swin transformer 모델 구조를 결합한 STHarDNet 모델 구조를 제안한다. 기존 뇌졸중 영상 분할 연구에는 CNN 구조를 이용한 encoder-decoder 구조를 가진 U-Net 형태의 모델, vision transformer를 이용한 segmentation 모델, CNN의 encoder-decoder 구조 모델의 bottleneck에 vision transformer을 결합한 모델들이 많이 제안된다. 하지만 기존 CNN 모델은 모델 size가 크고 계산 속도가 느리며, vision transformer 모델은 이미지 size가 커지면 계산 양이 급증하는 문제가 있다. 본 연구에서는 HarDNet block을 기반으로 구축된 encoder-decoder 구조를 가진 U-Net 형태의 경량화 모델에 swin transformer block으로 구성된 segmentation 모델을 결합했다. swin transformer 모델의 shifted windows approach 및 hierarchical transformer의 특징을 유지하기 위해 encoder-decoder의 bottleneck에 swin transformer을 사용한 것이 아니라 encoder의 처음 skip connection layer에 사용한다. 제안하는 모델의 우수성을 증명하기 위해 82,636장의 뇌출혈 CT 영상 및 229개 T1-weighted MRI scan 영상으로 구성된 Anatomical Tracings of Lesions After Stroke(ATLAS) 데이터셋을 학습 및 검증셋으로 분리해 모델의 성능 비교 실험을 진행했다. 실험 결과 뇌출혈 CT 데이터셋에서 제안하는 모델의 dice는 0.728로 가장 우수했다. 그리고 ATLAS 데이터셋에서 제안하는 모델의 dice, IoU, Precision, Recall은 각각 0.5547, 0.4185, 0.6764, 0.5286로 U-Net, SegNet, PSPNet, HarDNet, TransHarDNet, Swin Transformer, Swin unet, X-Net, D-UNet 등 lesion segmentation 분야에서의 state-of-the-art(SOTA) 모델들 보다 우수했다. 그리고 모델의 속도 비교 실험을 진행한 결과 제안하는 모델은 10만장 영상을 처리할 때의 FPS가 299.943으로 두 번째로 빨랐다(HardNet 보다 2.48% 느림). 본 연구에서 제안하는 모델은 segmentation 성능 및 계산 속도를 종합적으로 볼 때 기존 SOTA 모델보다 우수했다.

(패션)유사 패션 상품 검색, 추천, 분류, virtual try-on 등의 패션 이미지 분석을 위해서는 정확한 상품의 특징 추출이 매우 중요하다. 상품의 특징 추출 정확도가 낮으면 서비스의 quality도 함께 낮아지기 때문이다. 이러한 특징 추출의 정확도를 높이는 데 있어 이미지에서 semantic segmentation을 이용해 패션 상품의 영역만을 정확히 추출하는 것은 매우 효과적인 방법이다. 패션 상품 이미지의 경우 모델(사용자)이 상품을 걸치고 있는 경우가 많아 팔이나 액세서리, 다른 의상 등으로 상품의 영역을 가리는 occlusion이 자주 발생한다. 기존의 semantic segmentaion 기반의 상품 영역 추출 방법은 상품에 이러한 occlusion 영역이 있을 때 occlusion 영역을 상품의 영역에서 제거하거나 상품의 영역에 포함한다. occlusion 영역을 패션의 상품 영역에서 제거하면 패션 상품의 모양이 훼손(loss)되거나 occlusion 영역의 특징이 빠진다. 그리고 occlusion 영역을 패션 상품 영역에 포함하면 특징 추출시 상품 정보가 아닌 occlusion 영역 정보도 함께 포함되는 문제가 있다. 본 연구에서는 기존 semantic segmentation 기반 패션 상품 영역 추출 방법과 human parsing 방법을 이용해 상품을 가린 occlusion 영역을 자동으로 찾은 후 inpainting 기법으로 해당 occlusion 영역을 패션 상품의 원래 모양으로 복구하는 방법을 제안한다. 제안하는 방법의 우수성을 비교하기 위해 본 연구에서는 Deepfhshion2에서 제공하는 8,986장의 드레스 이미지로 유사 패션 상품 이미지 검색 실험을 진행했다. 실험 결과 occlusion 영역이 명확한 데이터셋에서 top-5 accuracy가 55.40%로 including occlusion 방법보다 2.96% 높고, excluding occlusion 방법 보다 4.51% 높다.*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

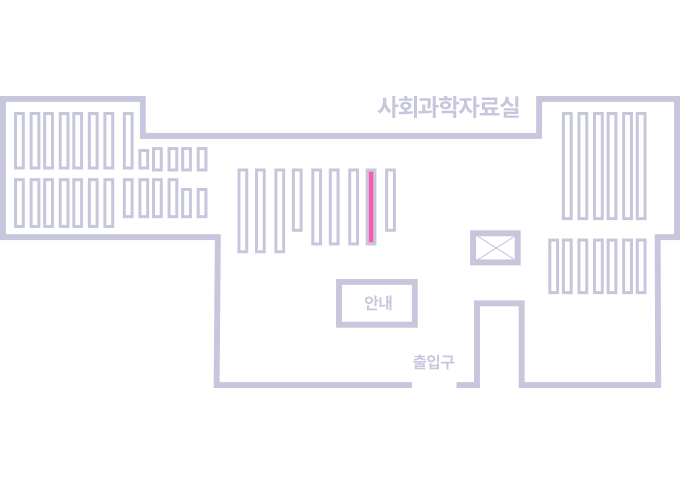

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.