권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

표제지 1

목차 6

약호표 13

국문요약 14

1. 서론 16

1.1. 연구의 배경 16

1.2. 연구의 목적 21

1.3. 연구의 내용 및 구성 23

2. 연구 동향 및 이론 24

2.1. 특징 추출 24

2.1.1. 각종 신경망 27

2.1.2. 오토인코더 35

2.2. 데이터 전처리 40

2.2.1. 데이터 전처리 40

2.2.2. 컴퓨터 비전 분야 데이터 전처리 42

2.3. 유사도 매트릭스 활용 선행연구 46

2.4. 생산성 평가 선행연구 50

3. 시스템 평가 실험 및 분석 53

3.1. 시스템 개요 53

3.2. 데이터 개요 54

3.2.1. 데이터셋 구축 55

3.2.2. 데이터 전처리 58

3.3. 오토인코더 구성, 학습, 성능 검증 61

3.4. 생산성 평가 67

3.4.1. 매트릭스 생성 68

3.4.2. 반복횟수 측정 71

3.5. 실험 환경 75

3.6. 실험 결과 78

4. 결론 및 향후 연구 방향 83

참고문헌 85

영문요약 90

그림 1-1. (a) 중소 제조기업 경영성과 추세, (b) 평균 매출액 및 기술개발비 18

그림 1-2. 연구의 AS-IS, TO-BE 22

그림 2-1. 머신러닝의 분류 26

그림 2-2. LeNet-5의 CNN 아키텍처 개요 29

그림 2-3. AlexNet의 CNN 아키텍처 개요 30

그림 2-4. ZFNet의 CNN 아키텍처 개요 31

그림 2-5. VGGNet의 CNN 아키텍처 개요 32

그림 2-6. GoogLeNet의 CNN 아키텍처 개요 33

그림 2-7. ResNet의 잔차 학습 개요 34

그림 2-8. 오토인코더의 구조 36

그림 2-9. 노이즈 제거 오토인코더 개요 37

그림 2-10. 희소 오토인코더 구조 개요 38

그림 2-11. 딥 오토인코더 구조 개요 39

그림 2-12. (a) 원본 RGB 이미지, (b) 회색조 이미지, (c) 이진화 이미지 43

그림 2-13. 본 연구에서 사용된 ROI 예시 44

그림 2-14. 배경 제거 개요 45

그림 2-15. VISIL 시스템 개요 47

그림 2-16. RepNet 시스템 개요 48

그림 2-17. FD를 통한 생산량 측정 방법 중 FD 평균... 50

그림 2-18. 작업 완료 후 산출 영역으로 작업물을 손으로 옮기는 행동 51

그림 2-19. (주)넥스트랩의 생산성 평가 딥러닝 네트워크 개요 52

그림 2-20. (주)넥스트랩의 딥러닝 네트워크 학습 데이터 레이블링 개요 52

그림 3-1. Hand Detection 결과 json 파일 예시 58

그림 3-2. Hand Detection 기반 ROI 자동설정 과정 59

그림 3-3. FD 적용 예시 60

그림 3-4. 본 연구에 사용된 오토인코더 중 인코더의 개요 62

그림 3-5. 오토인코더 학습 중 이진 교차 엔트로피 손실함수의 그래프 63

그림 3-6. 원본 이미지(좌)와... 66

그림 3-7. 자기 유사도 매트릭스 생성과정 69

그림 3-8. 매트릭스 데이터를 통한 생산량 도출 과정 개요 72

그림 3-9. 자기 유사도 매트릭스 중 일부 데이터의 그래프 74

그림 3-10. 실험 A의 결과 표출 터미널 캡처 화면 76

그림 3-11. 실험 B의 캡처 화면 77

그림 4-1. 작업자의 작업 완료 동작 84

본 연구는 비지도 학습 인공지능 신경망을 이용하여 수작업 제조공정에서 작업자의 반복 작업 영상으로부터 생산성을 실시간으로 평가하는 시스템에 관한 연구이다. 카메라를 통해 작업자의 수작업 반복 제조공정을 촬영하여 영상 프레임마다 인공지능 신경망을 활용한 특징 추출을 진행하고, 추출된 특징을 통해 영상의 자기 유사도 매트릭스를 생성한다. 인공지능 신경망에 활용할 학습 데이터와 검증 및 실험 데이터는 연구과제 협력 기업에서 촬영한 수작업 제조 공정 영상을 전처리하여 사용한다. 영상은 수작업 제조공정이 진행되는 공장에서 모두 평면 시점으로 촬영되었으며, 영상은 최소 1인 이상의 작업자의 반복제조 작업 활동을 포함하고 있다. 학습 데이터는 작업자의 손 이동 범위를 자동으로 탐지하여 영상 내에서 ROI(Region Of Interest)가 지정되고, ROI 정보와 Frame Difference 기법을 통해 영상 내에서 움직임이 있는 데이터를 이미지로 추출하여 인공지능 신경망의 비지도 학습에 사용된다. 인공지능 신경망으로는 입력 데이터가 정답 레이블의 역할을 하여 학습 데이터의 레이블링이 필요 없는 비지도 학습 신경망인 오토인코더를 사용한다. 학습된 오토인코더를 통해 영상 내 이미지의 특징을 추출한다. 추출된 특징 간의 유사도 계산에는 코사인 유사도 계산법을 사용한다. 계산된 유사도를 활용한 세가지 실험 방법을 통해 생산량을 계측한다. 첫 번째는 자기 유사도 매트릭스를 생성하여 생산량을 계측, 두 번째는 입력된 영상에 ROI를 직접 지정한 후, 원하는 한 장면에서부터 특징 추출을 진행해 유사도 계산을 진행해 생산량을 계측, 마지막은 두 번째 실험 방법과 동일하지만, 연속된 프레임 특징의 유사도를 비교하여 생산량을 계측한다. 이러한 작업자의 생산량을 계측하는 알고리즘을 연구하고 시스템의 성능 평가와 개선을 진행한다.

결과적으로 사람이 직접 데이터를 레이블링해 학습 데이터를 구축하지 않아도 되는 비지도 학습과 카메라를 이용함으로써 작업자, 작업물의 종류에 관계없이 시간 소모가 적고, 효율적이며 비용 소모가 적은 실시간 수작업 제조공정 생산성 평가가 가능하다.*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

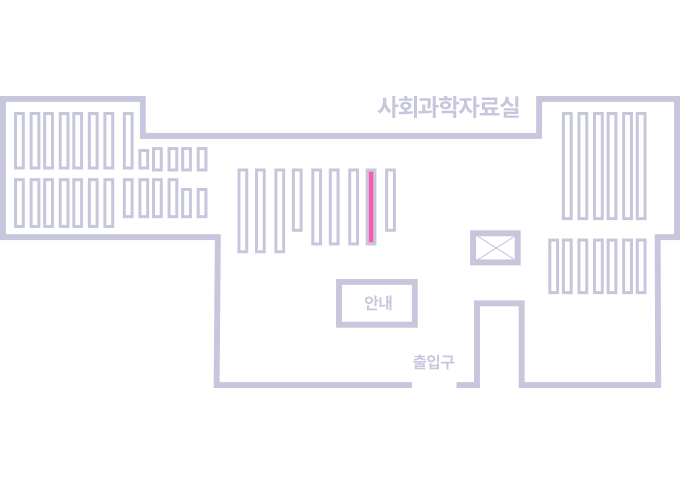

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.