권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

결과 내 검색

동의어 포함

표제지

국문 초록

목차

제1장 서론 18

1.1. 연구 배경 18

1.2. 연구동향 22

1.2.1. 자율주행 기술 연구 동향 22

1.2.2. 국외 로보택시 서비스 동향 27

1.2.3. 국내 로보택시 서비스 동향 30

1.3. 연구목적 33

제2장 자율주행 차량 제어 시스템 설계 34

2.1. SaFAD(Safety first for automated driving) 34

2.1.1. SaFAD 34

2.1.2. SaFAD의 목적 및 구성 35

2.1.3. SaFAD의 자율주행 시스템 기능적 역량 36

2.1.4. SaFAD의 자율주행 시스템 구성 요소 37

2.1.5. SaFAD에서 제시한 일반 아키텍처(Generic architecture) 39

2.2. HIUS 자율주행 시스템 설계 40

2.2.1. HIUS의 자율주행 시스템 아키텍처 40

2.2.2. 자율주행 시스템 구현을 위한 시스템 분류 51

제3장 자율주행 시스템 개발 52

3.1. 자율주행 차량 하드웨어 시스템 개발 52

3.1.1. 자율주행 하드웨어 시스템 개요 52

3.1.2. 차량 주행 액추에이터 구현 54

3.1.3. 차량 통합 제어 모듈(Vehicle control unit, VCU) 58

3.1.4. 전원 공급 장치 구성 62

3.2. 자율주행 차량 소프트웨어 시스템 64

3.2.1. 자율주행 시스템의 통신 인터페이스 구성 64

3.2.2. 자율주행 시스템 소프트웨어 인터페이스 67

3.2.3. 주변 환경 인지를 위한 센서 인터페이스(Sensor Interface) 69

3.2.4. 주행 상황 판단 인터페이스(Perception) 69

3.2.5. 주행 계획(Drive planning) 71

3.2.6. 미션 수행을 위한 서버와의 통신(Server) 73

제4장 자율주행 알고리즘 76

4.1. 목표 속도 정의 76

4.2. 차량 종방향 제어 알고리즘 78

4.2.1. 속도 추종 알고리즘 78

4.2.2. Soft Stop 알고리즘 85

4.2.3. 곡률 반영 속도 알고리즘 88

4.2.4. 정지선 정지 알고리즘 97

4.2.5. 차간 거리 유지 알고리즘 99

4.3. 차량 횡방향 제어 알고리즘 100

4.3.1. 차량 횡방향 제어 알고리즘 개요 100

4.3.2. Pure pursuit 100

4.4. 차선 변경 알고리즘 103

4.5. 인식 센서 알고리즘 105

4.5.1. LiDAR 센서 알고리즘 105

4.5.2. 카메라 센서 알고리즘 110

4.5.3. GNSS의 위치 인식 115

제5장 경로 계획 117

5.1. 경로 계획 개요 117

5.2. 정밀지도를 활용한 지도 데이터 구축 118

5.2.1. 정밀지도의 데이터 구성 118

5.2.2. 자율주행용 지도 데이터 제작 121

5.3. 전역 경로 생성 129

5.3.1. 전역 경로 생성 개요 129

5.3.2. 전역 경로 생성 130

제6장 실험검증 135

6.1. 실험 환경 135

6.1.1. 실험 장소 135

6.1.2. 시스템 구현 및 알고리즘 구현 툴(Tool) 136

6.1.3. 경로 추종 오차에 대한 설정 137

6.2. 실험 시나리오 138

6.2.1. 시나리오 1 : 자율주행 레벨 3단계 수준의 단위 기능 미션 138

6.2.2. 시나리오 2 : 자율주행 레벨 4단계 수준의 로보택시 미션 141

6.3. 실험 결과 148

6.3.1. 시나리오 1 : 자율주행 레벨 3단계 수준의 단위 기능 미션 148

6.3.2. 시나리오 2 : 자율주행 레벨 4단계 수준의 로보택시 미션 153

6.4. 실험 결론 및 고찰 164

6.4.1. 시나리오 1 : 자율주행 레벨 3단계 수준의 단위 기능 미션 164

6.4.2. 시나리오 2 : 자율주행 레벨 4단계 수준의 로보택시 미션 165

6.4.3. 사고사례와 비교한 자율주행 시스템의 강건성 비교 166

제7장 결론 168

참고 문헌 170

ABSTRACT 176

그림 1.1. 자율주행 단계 구분(국토교통부) 18

그림 1.2. 다양한 로보택시 사고사례 19

그림 1.3. 울트라 크루즈 컴퓨팅 아키텍처(좌)와 로보택시 Cruise(우) 27

그림 1.4. 로보택시 웨이모 원과 웨이모 드라이버를 통한 자율주행 28

그림 1.5. 바이두의 로보택시와 아폴로 고를 이용한 자율주행 시현 29

그림 1.6. 아폴로 8.0 소프트웨어 아키텍쳐 30

그림 1.7. 모셔널의 로보택시(좌)와 로보라이드 카헤일링(우) 31

그림 1.8. 아이오닉5 자율주행 차량의 운전석(좌) 및 플랫폼 제어 콘솔(우) 31

그림 2.1. Safety first for automated driving (SaFAD) 34

그림 2.2. SaFAD의 내용 구성 35

그림 2.3. SaFAD의 안전을 고려한 자율주행 일반 아키텍처 39

그림 2.4. HIUS 자율주행 시스템 아키텍처 40

그림 2.5. HIUS 자율주행 시스템의 환경 인식 센서의 위치 선정 41

그림 2.6. 국토지리정보원의 정밀지도 관련 소개 자료 42

그림 2.7. 지능형자동차부품진흥원의 신호등 관련 통신 구성 43

그림 2.8. 자율주행 차량에 근접한 관련 정적 및 동적 객체의 인식 44

그림 2.9. HIUS 자율주행 시스템의 위치 인식 요소에 대한 상호관계 46

그림 2.10. HIUS 자율주행 시스템의 모드 관리자 요소의 상호관계 47

그림 2.11. HIUS 자율주행 시스템의 차량 주행 제어 요소의 상호관계 49

그림 3.1. HIUS001 자율주행 차량 및 센서 장착 53

그림 3.2. 기존 자율주행 차량의 조향, 제동, 가속 엑츄에이터 장착 예 54

그림 3.3. SONATA DN8의 R-MDPS와 APM 모듈 55

그림 3.4. 조향각 제어 모듈 명령 흐름도 56

그림 3.5. 속도 제어 모듈 명령 흐름도 57

그림 3.6. SONATA DN8의 VDC 모듈과 ASM 모듈 57

그림 3.7. BCM 모듈의 제어 흐름도 58

그림 3.8. VCU의 소프트웨어 구성도 58

그림 3.9. 자율주행 모드 관리자의 기능 고장 검출 흐름도 60

그림 3.10. VCU의 하드웨어 구성 61

그림 3.11. HIUS001에 적용된 전원 공급 시스템 63

그림 3.12. HIUS001의 통신 인터페이스 구성 64

그림 3.13. 지능형자동차부품진흥원의 WAVE 통신 모듈(OBU) 구성 67

그림 3.14. HIUS001의 소프트웨어 인터페이스 구성도 68

그림 3.15. Mission Planner 구성도 71

그림 3.16. Path Planner 구성도 72

그림 3.17. Cruise Planner 구성도 72

그림 3.18. V2X 통신 시스템 구성 73

그림 3.19. V2X Server 와 OBU의 통신 구성 74

그림 3.20. RSU와 OBU 통신 구성 74

그림 3.21. Mission Gateway와 MCU의 통신 구성 75

그림 4.1. 속도 단계 알고리즘 구성도 77

그림 4.2. 속도 추종 알고리즘 개요 79

그림 4.3. 가속도 추종 PID 제어기 83

그림 4.4. 명령 속도 제어 테스트 결과 84

그림 4.5. 감속 모드에 따른 가속도 변화 실험 결과 87

그림 4.6. 곡률 반영 속도 알고리즘 개념도 89

그림 4.7. 주행 경로 기반 곡률반경 계산을 위한 컨셉 90

그림 4.8. 주행 경로 기반 곡률반경 계산 알고리즘 구성도 92

그림 4.9. 곡선 경사로 주행 시 차량에 작용하는 원심력 93

그림 4.10. 곡률 반영 속도 알고리즘 테스트 결과 96

그림 4.11. 목적지 정지 알고리즘의 흐름도 97

그림 4.12. 신호 정지선의 정지 알고리즘의 흐름도 98

그림 4.13. 차간 거리 유지 알고리즘의 흐름도 99

그림 4.14. Pure pursuit geometry 101

그림 4.15. 차선 변경 알고리즘 컨셉 104

그림 4.16. 차선 변경 알고리즘 흐름도 104

그림 4.17. HIUS001 에 장착된 LiDAR 센서 위치 105

그림 4.18. 객체 추적을 위한 알고리즘 구성도 106

그림 4.19. 지면점 제거 처리 전(좌)과 후(우) 107

그림 4.20. 병합된 전후방 센서의 감지 범위 107

그림 4.21. Voxel grid filter 적용 전(좌)과 후(우) 108

그림 4.22. 클러스터링 결과 108

그림 4.23. UKF 알고리즘 개념도 109

그림 4.24. GNN 알고리즘 개념도 110

그림 4.25. Camera 데이터 통신 구성도 111

그림 4.26. Camera 데이터 처리 과정 흐름도 111

그림 4.27. YOLOv4 CNN 구조 112

그림 4.28. Python LabelIMG 112

그림 4.29. YOLOv4 학습 결과 그래프 113

그림 4.30. 딥러닝으로 장애물 상자를 검출한 결과 114

그림 4.31. 딥러닝으로 보행자 더미(dummy)를 검출한 결과 114

그림 4.32. 딥러닝으로 과속방지턱 표지판을 검출한 결과 114

그림 4.33. GNSS 시스템 장착 위치 115

그림 5.1. 국토지리정보원의 정밀도로지도 예시 118

그림 5.2. 정밀도로지도를 이용한 포인트 클라우드 자율주행용 지도 생성(정밀지도 장소 : 지능형자동차부품연구원(KIAPI)) 122

그림 5.3. 주행 경로 링크의 가공 과정 124

그림 5.4. RANSAC 알고리즘 적용 결과 125

그림 5.5. Link Hashmap 126

그림 5.6. 횡단보도의 Point cloud 개념도 127

그림 5.7. 자율주행용 지도 데이터 단위 속성의 개념 128

그림 5.8. KIAPI의 자율주행 로보택시 미션 시나리오 경로 송신 129

그림 5.9. 주행경로링크 배열 생성 알고리즘 130

그림 5.10. 자율주행용 지도의 전체 주행 링크 정의 133

그림 5.11. 생성된 전역 주행 경로(좌)와 데이터 파일(우) 134

그림 6.1. 다양한 실험이 가능한 KIAPI 테스트 트랙 135

그림 6.2. LabVIEW 구현한 HIUS001 자율주행 프로그램 136

그림 6.3. 경로 추종 오차 측정 방법 개념도 137

그림 6.4. 2022 대학생 자율주행 경진대회에 출전한 HIUS001 142

그림 6.5. 실험 시나리오 2의 미션 구간 144

그림 6.6. 과속방지턱 이벤트 상황 예시 145

그림 6.7. 차량 수하물 낙하 이벤트 낙하 예시 145

그림 6.8. 정차된 차량 대응 이벤트 상황 예시 146

그림 6.9. 정차 차량 회피를 위한 차선 변경 이벤트 상황 예시 146

그림 6.10. 보행자 무단횡단 이벤트 상황 예시 147

그림 6.11. 보행자 신호 정지 이벤트 상황 예시 147

그림 6.12. 고속주회로 추종 결과 148

그림 6.13. 2차선에서 3차선으로의 차선 변경 미션 수행 150

그림 6.14. 자율주행 3단계 단위 기능 미션 수행 결과 151

그림 6.15. 시나리오 1에 대한 자율주행 테스트 모습 152

그림 6.16. 시나리오 2에 대한 자율주행 테스트 주행 경로 궤적 153

그림 6.17. 시나리오 2에 대한 전체 주행 속도 그래프 154

그림 6.18. 과속방지턱 감지 이벤트 수행 155

그림 6.19. 카메라 센서를 통한 차량 수하물 낙하 감지 156

그림 6.20. LiDAR 센서를 통한 차량 수하물 낙하 감지 156

그림 6.21. LiDAR 센서를 통한 거리 및 상대 속도정보 획득 157

그림 6.22. ACC 수행 중 속도 변화 157

그림 6.23. 차선 변경 이벤트 속도 그래프 158

그림 6.24. 차선변경 경로 궤적 159

그림 6.25. 보행자 무단횡단 이벤트 속도 그래프 160

그림 6.26. LiDAR 센서를 통한 무단횡단 보행자 인식 161

그림 6.27. 보행자 신호 정지 이벤트 테스트 환경 162

그림 6.28. 보행자 신호 정지 이벤트 속도 그래프 162

그림 6.29. LiDAR 센서를 통한 횡단보도 내 보행자 인식 163

그림 6.30. 노이즈 발생에도 객체를 지속적으로 추적 167

*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

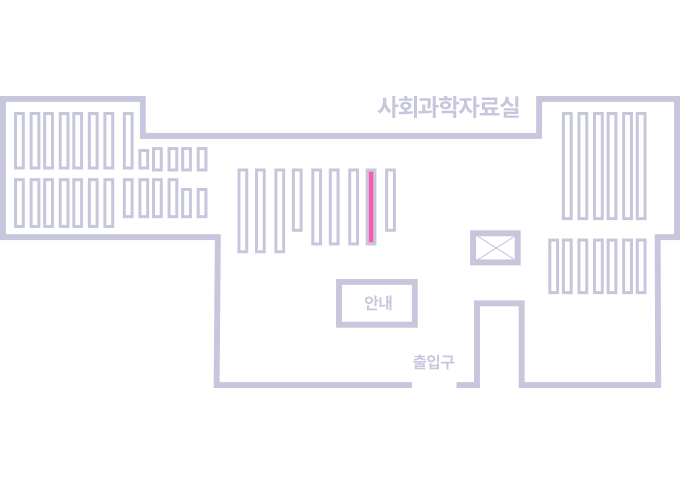

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.