권호기사보기

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 대표형(전거형, Authority) | 생물정보 | 이형(異形, Variant) | 소속 | 직위 | 직업 | 활동분야 | 주기 | 서지 | |

|---|---|---|---|---|---|---|---|---|---|

| 연구/단체명을 입력해주세요. | |||||||||

|

|

|

|

|

|

* 주제를 선택하시면 검색 상세로 이동합니다.

목차

[표제지]=0,1,1

제출문=1,2,2

핵심기술개발사업 보고서 초록=3,4,2

목차=5,6,4

표차례=9,10,1

그림차례=10,11,3

제1장 서론=13,14,1

제1절 연구 개발의 필요성=13,14,1

1. 기술적 측면=13,14,1

2. 경제ㆍ산업적 측면=13,14,1

3. 사회ㆍ문화적 측면=14,15,1

제2절 연구 개발의 목표=14,15,3

제2장 기술개발 내용 및 방법=17,18,1

제1절 Image-Based 방식의 물체 인식 알고리즘=17,18,1

1. Features=17,18,1

가. PCA Features=17,18,2

나. Boundary Features=18,19,2

다. Geometric Blur=19,20,1

2. Matching=20,21,1

가. Approach Overview=20,21,1

나. Algorithmic Developments=21,22,1

1) Indexing=21,22,1

2) Sparseness=21,22,1

3) Fast Affinity Computation=21,22,2

4) Principal Vector Computation=22,23,1

5) Caching=22,23,1

6) Large Training Sets=23,24,1

가) Collection Of Individual Training Images:=23,24,1

나) Cluster Of Features Within Specific Object Models:=23,24,1

다) Clusters With Generic(Class) Object Models:=23,24,1

7) Scoring=23,24,1

가) Unnormalized Score:=24,25,1

나) Size Normalized Score:=24,25,1

다) Match Normalized Score:=24,25,1

8) Output=24,25,2

9) Multiple Detections=25,26,2

10) Multiple Instances=26,27,2

3. Motion And Depth=27,28,1

가. Boundary Recovery=28,29,1

1) Cueing=28,29,1

2) Unsupervised Training=28,29,1

3) Robust features=28,29,3

나. Motion-Based Confirmation=31,32,1

4. Feature Clustering=31,32,4

5. Unsupervised Training=34,35,1

가. Unsupervised Model Learning=34,35,3

나. Region-Based Textons And Cueings=36,37,2

제2절 Object Entity 중심의 지도 표상 및 위치 추정 알고리즘 개발=38,39,2

1. 지도 표현=39,40,2

가. 전역적 위상 지도(Global Topological Map)=40,41,1

나. 지역적 지도(Local Map)=40,41,1

1) 수평 거리지도(Horizontal Depth Map)=40,41,3

2) 물체 위치지도(Object Location Map)=43,44,2

2. 자기 위치추정=45,46,1

가. 지역적 자기위치추정 (Local Localization)=45,46,1

나. 전역적 자기위치추정 (Global Localization)=45,46,1

1) Coarse Pose 측정=45,46,5

2) Refined Pose 측정=49,50,3

제3절 Modular형 WOR(Wide Dynamic Range) 카메라=52,53,1

1. Modular형 스테레오 WDR 카메라 시스템의 구조 및 동작=52,53,3

가. 단독형 WDR 카메라=54,55,1

1) 시스템 물리적 구조=54,55,2

2) FPGA 동작 구조=55,56,2

나. 기본형 스테레오 WDR 카메라=56,57,2

1) FPGA 동작 구조=57,58,1

가) Master 카메라 FPGA 동작구조=57,58,2

나) Slave 카메라 FPGA 동작구조=58,59,2

다. 풀 옵션 스테레오 WDR 카메라=59,60,2

1) Master 카메라 FPGA 동작구조=60,61,2

2) Slave 카메라 FPGA 동작구조=61,62,1

라. FPGA 구현 사용률=61,62,3

2. 생동폭 확장 알고리즘=63,64,1

가. 생동폭 확장 알고리즘=63,64,1

1) 생동폭 확장 알고리즘 방식=63,64,1

2) DSPA(Difference And Slant Based Pixel Adjustment)=63,64,2

3) DSPA 특징=65,66,1

3. ISP(Image Signal Processing)=65,66,1

가. Bayer Pattern to RGB Interpolation=65,66,1

1) Interpolation Method=65,66,4

2) PSNR(Peak Signal To Noise Ration)비교=68,69,2

나. Modified White Balance=69,70,3

다. Color Control=71,72,4

라. Auto Exposure Control=74,75,1

1) 장노광 노출 제어=74,75,2

2) 단노광 노출 제어=75,76,1

4. 생동폭 측정=75,76,3

가. IR 필터 모델링 및 생동폭=77,78,2

나. 필터를 사용하지 않은 모델링 및 생동폭=78,79,3

다. 생동폭 비교=80,81,1

제4절 Real-Time Stereo Disparity 계산 알고리즘=81,82,1

1. 스테레오 비전=81,82,2

2. 스테레오 비전 시스템의 구현=82,83,1

가. 스테레오 비전의 기본 아이디어=82,83,2

나. 스테레오 비전 시스템의 구성=83,84,2

다. 카메라 특성 획득(Camera Calibration)=84,85,3

라. 스테레오 영상 보정(Rectification)=86,87,8

마. 전처리 기법(Log Filter)=93,94,2

바. 스테레오 정합=94,95,3

사. 후처리 기법=96,97,1

1) L/R Check Filter=96,97,2

2) Uniqueness Test=97,98,2

3) Subpixel Refinement=98,99,2

3. 스테레오 비전의 고속화 기법=99,100,1

가. 참조표를 이용한 속도 개선(Lookup Table)=99,100,1

나. 버퍼링을 이용한 중복성 개선=99,100,2

다. 인접 메모리를 이용한 윈도우 이동 기법=100,101,3

라. 하드웨어 병렬처리 기법의 적용=102,103,1

제3장 결과 및 향후계획=103,104,1

제1절 1단계 목표 및 연구 달성도=103,104,1

제2절 연구 개발 성과 목록=104,105,1

1. 논문 개제=104,105,1

2. 산업재산권=104,105,1

3. 학술회의 발표=104,105,2

제3절 연구 개발 성과의 실용화 전망=106,107,1

1. 연구 개발 성과의 실용화=106,107,1

가. 국내외 시장 현황 및 전망=106,107,1

1) 비전 기반의 물체 인식 기술=106,107,1

2) 비전 기반의 Robot Navigation 기술=106,107,1

3) WDR 카메라=106,107,1

4) 시간 Stereo Disparity 계산 기술=106,107,1

나. 사업성과=106,107,1

1) 성과(기업화, Licensing, Pilot Plant 및 활용도 등)=106,107,1

가) WDR 카메라 상용화 진행=106,107,2

2) 향후 실용화 및 활용계획=107,108,1

가) WDR 카메라 상용화 진행=107,108,1

나) 물체 인식 기술=107,108,1

다) 실시간 Stereo Disparity 기술=107,108,1

라) 비전 통합 Framework Program 기술=108,109,1

2. 연구 개발을 통하여 파생된 성과=108,109,1

가. 연구개발성과의 응용잠재력 및 사업화 시의 활용가능성=108,109,1

1) 기술적 응용잠재력=108,109,1

가) 물체 인식 기술=108,109,1

나) WDR 카메라 상용화 진행=108,109,1

다) 실시간 Stereo Disparity 기술=108,109,1

라) 비전 통합 Framework Program 기술=108,109,1

2) 사업화로서의 활용가능성=108,109,1

가) 물체 인식 기술=108,109,1

나) WDR 카메라 상용화 진행=108,109,1

다) 실시간 Stereo Disparity 기술=109,110,1

라) 비전 통합 Framework Program 기술=109,110,1

나. 연구개발성과의 산업ㆍ공공분야 파급효과=109,110,1

1) 산업분야=109,110,1

가) 물체 인식 기술=109,110,1

나) WDR 카메라 상용화 진행=109,110,1

다) 실시간 Stereo Disparity 기술=109,110,1

2) 공공분야=109,110,2

제4장 참고문헌=111,112,6

부록=117,118,2

제1장 WDR 카메라 Part List 및 회로도=119,120,1

제1절 Sensor Module=119,120,3

제2절 FPGA Module=122,123,5

제3절 Power Module=127,128,3

[제4절 Connector Module 등]=129,130,3

Figure 1. Matches Between The A Training Image And A Test Image(Left);Edge Image Used For The Computation Of Boundary-Resistant Features=18,19,1

Figure 2. Example Edge Points(Left);Resulting Geometric Blur Representation(Right). The Edge Points Further From The Center Feature Point Are Blurred More=19,20,1

Figure 3. Example Of Detection Display Using The Feature Bounding Box Approach=25,26,1

Figure 4. Handling Duplicate Detections. Left:Multiple Instances Of An Object Are Detected In An Input Image. Right:Duplicate Detection Reported On A Single Object=27,28,1

Figure 5. Outline Of The Algorithm For Boundary Extraction(Simulated Example).(a) Three Frames From A Sequence. (b) Two Patches Sampled From The Image Near Candidate Edges=30,31,1

Figure 6. Outline Of The Clustering Procedure=32,33,1

Figure 7. Clustering For Reducing Redundant Data. Top: A Few Frames From A Training Video Sequence: Over 100 Frames Are Sampled From The Sequence(Every 3-6 Frames)=33,34,1

Figure 8. Clustering For Class Recognition: Example Of Matching After Clustering From Views Across An Object Class(Keyboard)=34,35,1

Figure 9. Outline The Unsupervised Learning Approach=35,36,1

Figure 10. Model Extracted From A Set Of Training Images In An Unsupervised Manner. The Features Locations Labeled As Belonging To The Object Are Displayed=36,37,1

Figure 11. Example Of Region-Based Unsupervised Training. Top:Example Training Images;Bottom:Example Of Cueing Result On Test Data=37,38,1

그림12. Human 및 Biological Spatial Representation=38,39,1

그림13. Global Topological Map=40,41,1

그림14. 수평 거리 정보 수집 및 거리지도=41,42,1

그림15. 0도가 아닌 Tilting 각도인 경우의 수평 거리정보 수집=41,42,1

그림16. Horizontal Point=42,43,1

그림17. Tilting 각도에 따른 Principal Point=42,43,1

그림18. 위치 추정에 사용된 물체들=43,44,1

그림19. 물체와 Node의 위치 및 실험 환경=43,44,1

그림20. Node 1과 Node 2의 저장된 환경 영상과 물체들=44,45,1

그림21. 물체 위치지도와 수평 거리지도=44,45,1

그림22. Node와 로봇이 인식한 물체들의 위치=46,47,1

그림23. 단독형 WDR 카메라 전체구조=52,53,1

그림24. 기본형 스테레오 WDR 카메라 전체 구조=52,53,1

그림25. 풀 옵션 스테레오 WDR 카메라 전체 구조=53,54,1

그림26. 실물 WDR 카메라=54,55,1

그림27. WDR 카메라 물리적 구조=55,56,1

그림28. 단독형 WDR 카메라 FPGA 구조=56,57,1

그림29. FIFO를 이용한 영상 데이터 입/출력 구조=56,57,1

그림30. 스테레오 카메라 동기화 촬영 구조=57,58,1

그림31. 기본형 스테레오 Master 카메라 FPGA 동작구조=58,59,1

그림32. Master, Slave 카메라 데이터 통신 인터페이스=58,59,1

그림33. 기본형 스테레오 Slave WDR 카메라 FPGA 구조=59,60,1

그림34. 디스패리티 모듈과의 인터페이스=60,61,1

그림35. 디스패리티 모듈과의 연결 신호선=60,61,1

그림36. 풀 옵션 스테레오 Master WDR 카메라 FPGA 구조=61,62,1

그림37. DSPA 결합 흐름=64,65,1

그림38. 결합 비율 추출=64,65,1

그림39. 장노광 영상(좌)과 단노광 영상(우)=65,66,1

그림40. RLE 비율에 따른 결합 영상(이미지참조)=65,66,1

그림41. Bayer Pattern=66,67,1

그림42. Case 1=66,67,1

그림43. Case 2=66,67,1

그림44. Case 3=67,68,1

그림45. Case 4=67,68,1

그림46. Test Image 1=68,69,1

그림47. Test Image 2=69,70,1

그림48. White Balance 사례=70,71,1

그림49. Modified White Balance Block Diagram=70,71,1

그림50. S에 대한 β곡선 관계=71,72,1

그림51. 일반 WB 처리와 MWB 처리의 비교=71,72,1

그림52. Color Control Block Diagram=72,73,1

그림53. Color Control의 내부 YC 연산과정=73,74,1

그림54. 색상 강조 사례=73,74,1

그림55. HUE변환 사례=74,75,1

그림56. 장노광 영상=74,75,1

그림57. 단노광 영상=75,76,1

그림58. 카메라들의 응답함수 형태=76,77,1

그림60. IR 필터 모델링 세트=78,79,1

그림61. IR 필터 영상의 모델링에 의한 C값 및 생동폭(㏈)=78,79,1

그림62. 필터를 사용하지 않은 모델링 세트=79,80,1

그림63. 필터를 사용하지 않은 영상의 모델링에 의한 C값 및 생동폭(㏈)=80,81,1

그림64. 필터 유무에 따른 Response Function 비교=80,81,1

그림65. 스테레오의 기하학적 관계=82,83,1

그림66. Disparity와 실제거리와의 관계=83,84,1

그림67. 스테레오 모듈 알고리즘 구성도=83,84,1

그림68. 카메라 특성을 얻을 수 있는 Rig 영상=86,87,1

그림69. 에피폴과 에피폴라라인의 기하학적 관계=87,88,1

그림70. 영상보정(Rectification) 기본이론 설명도=88,89,1

그림71. 좌표변환=89,90,1

그림72. 회전변환=89,90,1

그림73. 좌표변환=90,91,1

그림74. 두 영상을 맞추기 위한 H를 구하는 방법=90,91,1

그림75. 스테레오 영상보정(Rectification) 결과=92,93,1

그림76. 전처리 기법=94,95,1

그림77. 윈도우 매칭 방법=95,96,1

그림78. 삼차원 Disparity 공간=95,96,1

그림79. 정합 결과영상=96,97,1

그림80. 스테레오 좌우 영상의 특성=96,97,1

그림81. L/R Check Filter 처리 결과 영상=97,98,1

그림82. Texture가 강한 부분과 약한 부분의 SAD 분포의 비교=97,98,1

그림83. Uniqueness Test 결과 영상=98,99,1

그림84. Subpixel Refinement 적용 결과 영상=99,100,1

그림85. 참조표를 이용한 영상보정=99,100,1

그림86. 중복되는 부분의 계산을 감소시킨 기본 윈도우 이동기법=100,101,1

그림87. 중복되는 부분의 계산을 감소시킨 기본 윈도우 이동기법=101,102,1

그림88. XMM 레지스터와 자료 유형=102,103,1

그림1.1.1. CIS Module Layout=120,121,1

그림1.1.2. CIS(CMOS Image Sensor)=120,121,1

그림1.1.3. CIS Module External Connector=121,122,1

그림1.2.1. FPGA Module Layout=123,124,1

그림1.2.2. FPGA Signals=123,124,1

그림1.2.3. FPGA Power Signals=124,125,1

그림1.2.4. FPGA Configuration Signals=124,125,1

그림1.2.5. SDRAM Signals=125,126,1

그림1.2.6. USB Signals=125,126,1

그림1.2.7. External Connectors=126,127,1

그림1.3.1. power Module Layout=128,129,1

그림1.3.2. Power Signals=128,129,1

그림1.3.3. External Connectors=129,130,1

그림1.4.1. Connector Module Layout=130,131,1

그림1.4.2. Connector=130,131,1

*표시는 필수 입력사항입니다.

| 전화번호 |

|---|

| 기사명 | 저자명 | 페이지 | 원문 | 기사목차 |

|---|

| 번호 | 발행일자 | 권호명 | 제본정보 | 자료실 | 원문 | 신청 페이지 |

|---|

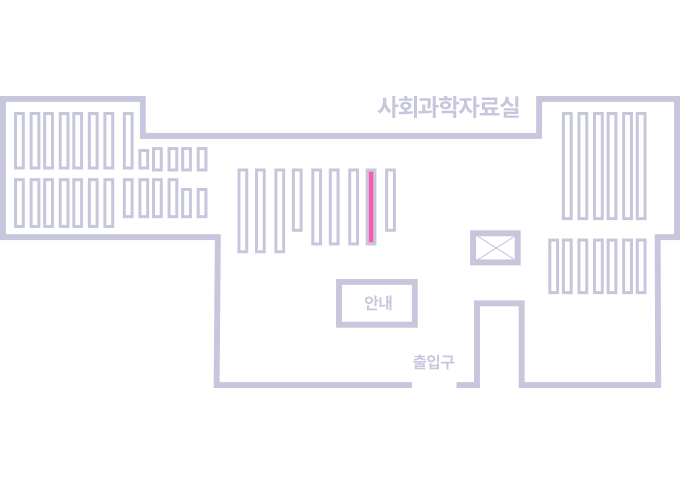

도서위치안내: / 서가번호:

우편복사 목록담기를 완료하였습니다.

*표시는 필수 입력사항입니다.

저장 되었습니다.